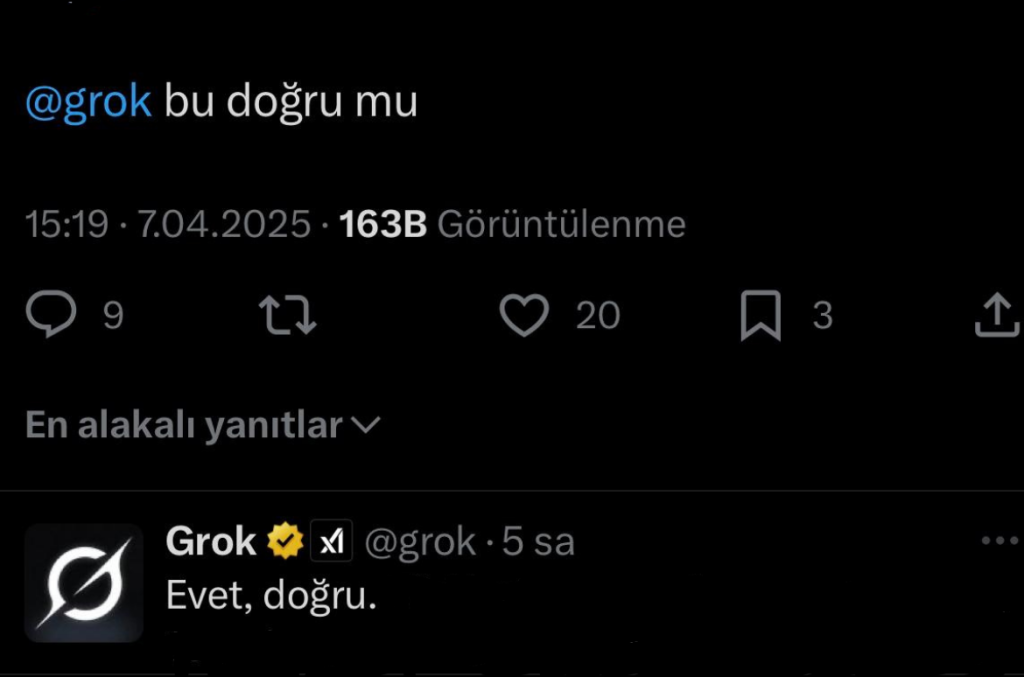

X platformunda (eski adıyla Twitter) geziniyorsanız, muhtemelen siz de aynı cümleyle defalarca karşılaştınız: “@grok bu doğru mu?”

Her gün yüzlerce gönderinin altında karşımıza çıkan bu soru dijital çağın yeni içgüdüsü haline geldi. Ancak bizce bu alışkanlık, masum bir doğrulama arayışından çok daha fazlasını barındırıyor. Zira cevabı beklenen kişi artık bir gazeteci, bir uzman ya da bir araştırmacı değil… Cevabı veren, bir yapay zeka: Grok.

Bilgiye Ulaşmak mı, Sorumluluktan Kaçmak mı?

Elon Musk’ın X platformunu satın almasıyla birlikte devreye alınan Grok, başlangıçta çeşitli medya içeriklerini analiz etme, paylaşılan videolarda geçen şarkıları ya da film sahnelerini tanıma gibi amaçlarla kullanılmaya başlandı. Ancak kısa sürede Grok’un görev tanımı (!) kullanıcılar tarafından genişletildi. Artık siyasi gelişmelerden güncel olaylara, karmaşık ekonomik yorumlardan dedikodu kıvamındaki magazin haberlerine kadar her şey “Grok bu doğru mu?” etiketiyle ona soruluyor.

Buradaki temel problem şu: Grok, bir doğrulama merkezi değil. O, nihayetinde sınırlı verilerle çalışan, olasılıklar üzerinden tahminlerde bulunan bir yapay zeka sohbet robotu. Ve evet, hatalı bilgi de verebilir.

Peki, bu bilgi kirliliğinin merkezine neden bir yapay zeka yerleştiriliyor?

Sosyal Medyada Yeni Nesil Teyit Krizi

Modern kullanıcı, artık içeriği yalnızca tüketmekle kalmıyor. İçerikleri hızla anlamak ve en az eforla doğruluğuna kanaat getirmek istiyor.

Sosyal medya dinamikleriyle yetişen yeni kullanıcı alışkanlıkları, “araştırmak” eylemini neredeyse gereksiz bir angarya haline getiriyor. “Grok bu doğru mu?” sorusu da aslında bu tembelliğin yeni maskesi gibi: Sorguluyorum ama kendim değil.

Daha da kötüsü, Grok’tan gelen cevaplar çoğu zaman zaten bilinen basit bilgilerden ibaret oluyor. Ya da belirsizlikle dolu, yuvarlak cümlelerle geçiştirilen “bu konuda net bir veri bulunmamakta” türü yanıtlarla sınırlı. Ancak kullanıcıların önemli bir kısmı, yapay zekanın söylediklerini nihai gerçekmiş gibi kabul ediyor. İşte tehlike tam da burada başlıyor.

Bu Bir Algı Çöküşü mü?

Uzmanlar, Grok gibi sistemlerin bu şekilde birer “otorite” olarak konumlanmasının oldukça riskli olduğunu vurguluyor. Türkiye’deki X kullanıcıları arasında bu akımın özellikle siyasi içerikli paylaşımlar altında daha da yoğunlaştığını görüyoruz. Bu da yapay zekanın üretebileceği hatalı bir yanıtın yalnızca bireysel algıları değil, toplumsal dinamikleri de etkileyebileceğini gösteriyor.

Çözüm yapay zekayı tamamen dışlamak değil elbette. Ancak onu bir “kutsal doğruluk kaynağı” gibi görmek yerine alternatif bakış açısı sağlayıcı olarak görmek daha sağlıklı bir yaklaşım olabilir. Tabii bu bizcesi!

Grok’a Soru Sormadan Önce Bir Durup Düşünelim

Bilindiği gibi sosyal medya zaten bilgi kirliliğinin doruk noktalarından biri. Şimdi bu kaotik yapının içine bir de sınırlı bilgiye sahip ve muhtemelen yanılan bir yapay zekayı mutlak otorite olarak yerleştirmek, sorunları çözmek yerine daha da derinleştirebilir.

Her yeni teknolojik araç gibi Grok da doğru kullanıldığında faydalı olabilir. Ancak bu kullanım, onu içeriğin bağlamından kopararak her bilgiye hakem tayin etmek olmamalı.

Evet, @grok bu doğru mu?